Úvod

Podľa informácií uvedených na stránke Európskeho parlamentu vníma AI technológie ako pozitívne 61% Európanov (European Parliament, 2023). Avšak až 88% obyvateľov Európy si myslí, že nad umelou inteligenciou a robotikou potrebujeme riadny dohľad. (European Parliament, 2023)

Umelá inteligencia (AI) predstavuje jednu z najvýznamnejších technologických inovácií 21. storočia, ktorá zásadne mení spôsob, akým komunikujeme, pracujeme a spracovávame informácie. Medzi jej najdôležitejšie podoblasti patrí generatívna umelá inteligencia (Generative AI), ktorá má schopnosť vytvárať nové obsahy – texty, obrázky, videá či zvuk – na základe existujúcich dát. Tento technologický pokrok otvára obrovské možnosti pre kreatívny priemysel, vzdelávanie či zábavu. Na druhej strane však prináša aj výzvy a riziká, najmä v kontexte šírenia nepravdivých informácií, známych ako fake news, a tvorby deepfake materiálov.

Tie nie sú novým fenoménom. Avšak vďaka pokročilým nástrojom umelej inteligencie sa možnosti ich tvorby a šírenia dramaticky zmenili. Ako spoločnosť tak čelíme novým hrozbám a sme nútení hľadať efektívne riešenia na to ako ich zvládnuť.

Cieľom tejto práce je preskúmať fenomén fake news generovaných umelou inteligenciou, uviesť virálne príklady ich zneužitia za posledné obdobie v rôznych sférach spoločenského života a prostredníctvom nich analyzovať dopad tohto trendu na spoločnosť. Koniec práce je zameraný na preskúmanie konkrétnych riešení, ktoré by mohli pomôcť zmierniť narastajúci trend fake news a deepfake materiálov a zabrániť ich nevhodnému používaniu.

Umelá inteligencia

Aj keď sa s pojmom umelá inteligencia (artificial intelligence – AI) stretávame často, je pomerne náročné ho jasne definovať. Toto združené pomenovanie sa skladá z dvoch slov. Pojem inteligencia podľa Cambridge Dictionary (2024) znamená schopnosť učiť sa, chápať a robiť úsudky či mať názory založené na rozume (vlastný preklad). Ak k tomu teda pridáme pojem umelý či umelá, prenášame túto schopnosť z človeka na niečo neživé ako napr. technológiu, zariadenie či systém. Dostávame sa tak k vysvetleniu pojmu umelá inteligencia uverejnenom v článku na Brittanica.com, v ktorom sa píše, že umelá inteligencia (AI) je schopnosť digitálneho počítača alebo počítačom riadeného robota vykonávať úlohy bežne spojené s inteligentnými bytosťami. Tento termín sa tiež často používa na projekt vývoja systémov vybavených intelektuálnymi procesmi charakteristickými pre ľudí, ako je schopnosť uvažovať, objavovať význam, zovšeobecňovať alebo schopnosť učiť sa z minulých skúseností. (Copeland, 2024, vlastný preklad).

Využitie umelej inteligencie v bežnom živote je viac než aktuálne. Je súčasťou rôznych internetových vyhľadávačov, digitálnych asistentov či inteligentných zariadení v našich domácnostiach. Softvéry na preklad jazykov sa taktiež spoliehajú na umelú inteligenciu, čo sa napríklad prejavuje aj v generovaní automatických titulkov pod videami. Autonómne vozidlá ešte síce nie sú štandardom, avšak dnešné automobily už vďaka umelej inteligencii využívajú viaceré bezpečnostné prvky. Jej vplyv sa prejavuje aj v kybernetickej bezpečnosti a rozpoznávaní možných hrozieb. Takisto je vo veľkom využívaná v automatizovaných výrobných závodoch, či v poľnohospodárskom priemysle. A do budúcna má AI obrovský potenciál zmeniť viaceré aspekty nášho života, na ktoré sme zvyknutí (Európsky parlament, 2023)

Generatívna umelá inteligencia

Generatívna umelá inteligencia (generative artificial intelligence – GAI) je pokročilá forma umelej inteligencie (AI), ktorá sa zameriava na tvorbu nového obsahu, ako sú texty, obrázky, zvuky, hudba a videá. Tento typ AI využíva rôzne algoritmy na generovanie obsahu, ktorý je v dnešnej dobe už často neodlíšiteľný od toho, čo vytvárajú ľudia. Schopnosť generovať takýto obsah je postavená na komplexných algoritmoch, ktoré dokážu analyzovať a napodobniť ľudské vzorce tvorby. (Mirga, 2024)

Táto technológia je využívaná v rozličných oblastiach, najmä za účelom zjednodušiť tvorbu nového obsahu. Efektívne sa dá využiť najmä pri úlohách vyžadujúcich kreativitu. Typickým príkladom je jej uplatnenie v umeleckom a filmovom priemysle, architektúre, reklame či marketingu.

Ako to funguje? Generatívna umelá inteligencia pracuje na základe učenia sa z obrovských množstiev dát, ktoré sú následne analyzované algoritmami. Tieto algoritmy identifikujú vzory a vzťahy v dátach, ktoré im umožňujú vytvárať nové výstupy, ktoré sa podobajú na pôvodné vzory. V prípade generovania textu modely ako GPT-4 spracujú veľké množstvo textových dát a na ich základe vytvoria nový text. Pri generovaní obrazov a videí sa využívajú algoritmy ako Generatívne adversariálne siete (GAN), ktoré sú založené na dvoch modeloch, ktoré pracujú súčasne – jeden generuje nový obsah a druhý ho hodnotí, či je podobný pôvodným dátam. (Zewe, 2023)

V oblasti generovania falošných obrazov a videí, známym ako deepfake, sa GAI využíva na vytváranie realistických, ale nepravdivých materiálov. Deepfake videá sú vytvorené tak, že umelá inteligencia kombinuje a modifikuje skutočné videá, čím vytvára falošné, no veľmi realistické zobrazenia. Táto technológia sa často používa na zmenu výrazu tváre, pohybov a hlasu jednotlivca, čím sa vytvára dojem, že niekto povedal alebo urobil niečo, čo sa v skutočnosti nestalo. Algoritmy, ktoré sa používajú na generovanie deepfake sa učia na veľkých databázach videí a fotografií a dokážu napodobniť spôsob, akým sa človek správa pred kamerou, vrátane jemných detailov, ako sú pohyby očí alebo tón hlasu. (Zewe, 2023)

Fake news

Definícia fake news, podobne ako definícia umelej inteligencie, nie je jednotne daná. Pri zamyslení sa nad jednotlivými slovami získame čiastočnú predstavu čo fake news predstavujú. Slovo fake znamená falošný, nepravdivý, umelý. Anglický pojem news predstavuje správy, novinky – takže určitý typ informácie. Vo ich vzájomnom spojení tak bežne prichádza k výrazom ako falošné správy či nepravdivé informácie.

Ak by sme hľadali rozsiahlejšiu definíciu získame fake news je úmyslená prezentácia (zvyčajne) nepravdivých alebo zavádzajúcich tvrdení, pričom tieto tvrdenia sú zámerne navrhnuté tak, aby zavádzali. (Gelfert, 2018, s. 108)

Podľa Rahmaniana, ktorý sa snažil v svojej práci fake news čo najlepšie klasifikovať fake news, bez ohľadu na objektívnu realitu, sú zámerne vytvorené pseudo-pravdivé informácie, ktoré majú za cieľ manipulovať presvedčenia cieľového publika s úmyslom dosiahnuť určité výhody. (Rahmanian, 2023)

Niektoré definície popisujú fake news aj ako prioritné pomenovanie pre ďalšie typy falošných správ akými sú dezinformácie, deepfakes, konšpiračné teórie, hoaxy, ale aj satirické články, ktoré sú nesprávne interpretované ako celkom pravdivé či clickbaitové titulky.

Deepfake

Slova deepfake je podľa Oxford Dictionary pravdepodobne odvodené zo slov deep learning (typ strojového učenia) a fake (falošný, nepravdivý). (Oxford English Dictionary, 2023)

Deepfake je všeobecne chápaný ako zmanipulovaný audiovizuálny materiál, ktorý je vytvorený pomocou umelej inteligencie. Táto technológia dokáže na základe relatívne malého množstva vstupných dát – autentických fotografií, videí alebo hlasových záznamov – generovať falošný obsah, ktorý vyzerá natoľko realisticky, že mu ľudia často uveria. (Tesař, 2022)

Termín deepfake sa v trendoch vyhľadávania na Google prvýkrát objavil na prelome rokov 2017 a 2018. Jeho pôvod je do istej miery spojený s porno priemyslom, kde sa technológia používala na vkladanie tvárí známych osobností do videí s cieľom zvýšiť sledovanosť Najväčší záujem však zaznamenal, keď sa na sociálnej sieti TikTok objavil profil imitujúci Toma Cruisa. Tento profil, ktorý otvorene prezentoval, že ide o falošnú identitu hollywoodskej hviezdy vykonávajúcej každodenné činnosti, sa stal virálnym hitom. (Tesař, 2022)

Odvtedy technológia deepfake výrazne pokročila a jej dostupnosť na tvorbu podobného obsahu sa značne zvýšila. Hoci technológia deepfake v budúcnosti môže nájsť mnohé pozitívne využitia, zároveň so sebou nesie veľké riziko zneužitia, čo je spoločné pre všetky technológie súvisiace s umelou inteligenciou. (Tesař, 2022)

Príklady deepfake

V tejto časti sa zameriavam na príklady falošných fotografií či videí, ktoré sa stali za posledné obdobie obzvlášť virálnymi. Predstavujú rôzne prostredia – od vojenských konfliktov, cez politické manipulácie až po celebrity a zábavu – čo len podčiarkuje, aké široké spektrum vplyvu môžu tieto technológie mať.

Prejav moldavskej prezidentky

Súčasná prezidentka Moldavska, Maia Sanduová, sa stala obeťou sofistikovaného deepfake útoku, ktorý mal za cieľ poškodiť jej povesť a oslabiť jej politickú pozíciu. Incident sa odohral tesne pred novoročným prejavom prezidentky, tradične vysielaným 31. decembra. Na platforme Telegram sa objavilo video, ktoré zobrazovalo Sanduovú, ako údajne blahoželá občanom k Novému roku a zároveň žiada o podporu v nadchádzajúcich voľbách. V prejave však dominovali irónia a sarkazmus, pričom prezidentka mala kritizovať ekonomickú situáciu v krajine a dokonca zosmiešňovať Moldavsko. Video mohlo na občanov pôsobiť dôveryhodne, ale jeho obsah bol umelo vytvorený falšovaním obrazu a zvuku. (Gregová, 2024; Necsutu, 2023)

Moldavsko, ktoré sa dlhodobo zmieta v geopolitických tlakoch a čelí dezinformačným kampaniam najmä zo strany Ruska, je opakovane cieľom podobných útokov. Prezidentka Sanduová je známa svojou prozápadnou orientáciou a snahou o demokratizáciu krajiny, čo ju robí terčom ruských záujmov, ktoré podporujú destabilizáciu regiónu. Podľa ukrajinských zdrojov malo Rusko dokonca plán zosadiť moldavské vedenie, a spomínané video mohlo byť len súčasťou širšej kampane na diskreditáciu jej osobnosti. Prezidentská kancelária promptne zareagovala a vyhlásila, že video je falošné a prezidentka sa od jeho obsahu dištancuje. (Gregová, 2024; Necsutu, 2023)

Podobné dezinformačné aktivity pokračovali v Moldavsku aj neskôr. Dva dni pred voľbami sa na sociálnych sieťach objavilo ďalšie falošné video, tentoraz zdieľané cez viaceré facebookové stránky. Na videu údajne Sanduová oznamovala svoju rezignáciu a vyzývala občanov, aby hlasovali za pro-rusky orientovanú politickú stranu. Tieto manipulácie mali za cieľ zmiasť voličov a oslabiť jej podporu v rozhodujúcom momente. (Gregová, 2024; Necsutu, 2023)

Moldavsko, ktoré je od roku 2022 kandidátskou krajinou na vstup do Európskej únie zatiaľ nezaviedlo žiadne právne kroky, ktoré by sa týkali používania umelej inteligencie. Je preto len ďalším dôkazom toho, že je potrebné zamyslieť sa nad potrebou obrany voči podobným digitálnym manipuláciám, ktoré sú nástrojmi hybridnej vojny a polarizujú spoločnosť.

Výzva ukrajinského prezidenta ku kapitulácii

Narastajúci trend deepfake videí neobišiel ani vojnový konflikt na Ukrajine. V marci 2022 sa na rôznych sociálnych platformách, najmä na Telegrame, objavilo video ukrajinského prezidenta Volodymyra Zelenského, ktorý sa prihovára ukrajinským občanom. V mierne emotívnom výstupe ich vyzýva, aby sa vzdali a ukončili vojnu s Ruskom. Prezident vo videu vyjadruje názor, že nestojí za to zomrieť v tejto vojne. (Burgess, 2022)

Hoci autor videa zostal neznámy, s vysokou pravdepodobnosťou sa dá predpokladať, že za jeho vytvorením stála pro-ruská skupina alebo jednotlivci, ktorí sa snažili vyvolať zmätok, narušiť dôveru ukrajinských občanov a zneistiť celú verejnosť. (Burgess, 2022)

Ukrajinská vláda na šírenie falošného videa okamžite reagovala a poprela ho v celom rozsahu. Zároveň ukrajinský prezident uverejnil vyjadrenie k celej situácii prostredníctvom videa na svojom oficiálnom účte na Instagrame. Následne falošné video sociálne siete ako Facebook, Youtube a X odstránili zo svojich platforiem, no pochopiteľne, v prostredí ruských sociálnych médií sa stalo populárnym. (Burgess, 2022)

Tento incident bol ďalším varovaním o zneužívaní deepfake technológie na manipuláciu verejnej mienky, najmä v kontexte vojenského konfliktu, kde manipulácia s informáciami môže mať vážne a nezvratné následky.

Pápež v značkovej bunde

Prípad, kedy využitie generatívnej umelej inteligencie spoločnosť skôr pobavil a zaujal je obrázok terajšieho pápeža Františka v štýlovej nafúknutej bielej bunde s kapucňou značky Balenciaga.

Tento obrázok bol vytvorený umelcom Pablom Xavierom, ktorý na prvý pohľad pôsobil realisticky, no zároveň vtipne a nečakane. Autor nápad dostal, keď bol pod vplyvom psychotropných látok, a priznal, že jeho cieľom nebolo šíriť dezinformácie, ale len zabaviť seba a okolie. Ako sám povedal: „Myslel som si, že by bolo vtipné vidieť pápeža vo vtipnej bunde“ (BuzzFeed, 2023). Technologicky bola tvorba obrázku relatívne jednoduchá. Pablo Xavier zadal požadovaný opis do AI generátora obrázkov, ktorý na základe textového zadania vytvoril fotorealistický obraz. Pablo vôbec nečakal, že sa stane virálnou tak rýchlo a zaujme širokú spoločnosť. (Stokel-Walker, 2023)

Pápež František k incidentu uviedol rozsiahle vyjadrenie. S dobrým úmyslom varoval pred možnými nástrahami umelej inteligencie a jej potenciál označil za „úchvatný a znepokojujúci zároveň“. Uviedol, že technológie, podobne ako veľa iných výdobytkov dnešnej doby, sa dajú použiť na dobré i zlé účely, v závislosti od našich rozhodnutí. Pápežova reakcia tak nebola kritika konkrétneho obrázka, ale skôr širšie varovanie pred nekontrolovaným využívaním technológií. (Novak, 2024)

Tento incident poukazuje na dve významné črty deepfake obsahu. Po prvé, že aj obsah vytvorený s dobrými úmyslami a bez zámeru manipulovať môže viesť k neúmyselnému šíreniu dezinformácií, ak nie je jasne označený ako nepravý. Po druhé, že takýto obsah môže byť spúšťačom diskusie o etických otázkach súvisiacich s umelou inteligenciou.

Zatknutie Donalda Trumpa

V marci 2023 sa na sociálnej sieti Twitteri objavili viaceré zábery zobrazujúce zatknutie Donalda Trumpa. Na falošných obrázkoch je bývalý prezident USA zobrazený ako uteká pred policajnými zložkami, prípadne sa im snaží vzdorovať. Takýto vizuálny obsah zaujal mnohých, najmä v kontexte obvinení, ktoré voči Trumpovi v tom čase prebiehali. V marci 2023 bol obvinený z falšovania obchodných záznamov v súvislosti s platbami, ktoré mal vykonať herečke Stormy Daniels, aby utajil ich údajný románik. Toto obvinenie vyvolalo silné verejné diskusie, a mnohí si mohli spájať zatknutie na týchto obrázkoch práve s touto kauzou. Navyše, v danom období bola aj medializovaná správa, že Trump čelí právnym problémom, čo pridávalo obrázkom na vierohodnosti. (AP News, 2023; Novak, 2023)

Polícia avšak potvrdila, že k zatknutiu neprišlo. Zábery neboli skutočné. Falošné obrázky zhotovil Eliot Higgins, zakladateľ a kreatívny riaditeľ holandskej organizácie Bellingcat, ktorá sa zameriava na overovanie informácií a analytické správy, často využívajúc verejne dostupné zdroje. Higgins pri uverejnení obrázkov uviedol informáciu, že fotografie nie sú reálne, ale vygenerované umelou inteligenciou. Aj napriek tomu niektorí používatelia sociálnych sietí tieto obrázky zdieľali bez tohto dôležitého kontextu. (AP News, 2023; Wikipedia, 2024)

Aj keď obrázky na prvý pohľad vyzerali realisticky, pozorní diváci si mohli všimnúť určité anomálie, ktoré odhalili, že ide o falošný obsah. Na jednom z obrázkov mal Donald Trump tri nohy, na inom nebol správny počet prstov na rukách zúčastnených osôb, a na ďalšom zábere ľudia v pozadí nekorešpondovali s prostredím. Higgins predpokladal, že si tieto nepresnosti čitatelia uvedomia, no ukázalo sa, že mnohí ich nepostrehli, čo podčiarkuje slabú úroveň kritického myslenia u niektorých používateľov sociálnych sietí. Tento incident jasne ukázal, aké dôležité je pri konzumácii mediálnych obsahov zachovávať kritický prístup a nezrýchľovať šírenie neoverených informácií. (AP News, 2023)

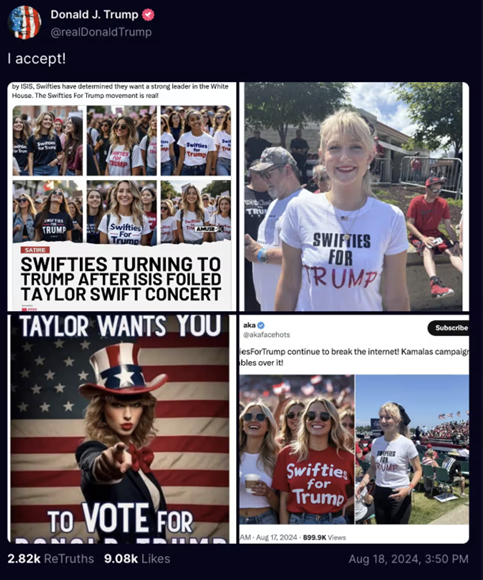

Taylor Swift a podpora Donalda Trumpa

Najnovším príkladom zneužitia deepfake technológie v politickom kontexte je prípad z augusta 2024, ktorý vyvolal rozruch počas kampane pred americkými prezidentskými voľbami. Donald Trump, uchádzajúci sa o znovuzvolenie, na svojich sociálnych sieťach zdieľal obrázky, ktoré naznačovali podporu zo strany známej speváčky Taylor Swift. Jeden z najsledovanejších príspevkov obsahoval obrázok Swift a skupiny jej fanúšikov (tzv. Swifites), ktorí mali oblečené tričká s nápisom „Swifities za Trumpa“ – čo malo vyvolať dojem jej oficiálnej podpory. (Robins-Early, 2024)

Tieto obrázky boli vygenerované pomocou umelej inteligencie a okamžite vzbudili kontroverzie. Taylor Swift sa nikdy verejne nevyslovila na Trumpovu podporu; naopak, je známa svojimi liberálnymi postojmi a predchádzajúcou kritikou Trumpovej administratívy. Po zverejnení týchto obrázkov jej tím rázne poprel ich pravosť a označil ich za manipuláciu. Taylor Swift patrí aktuálne medzi najznámejšie speváčky dnešnej doby. Jej popularita a schopnosť motivovať masy, napríklad prostredníctvom výziev na registráciu voličov, boli pravdepodobne hlavným dôvodom, prečo bola zneužitá v tejto propagande. Trump však tento incident nekomentoval, a preto mnohí považujú tento čin za súčasť jeho kampane na získanie pozornosti a polarizáciu verejnosti. (Robins-Early, 2024)

Krádež peňazí

Ukážkou toho, že manipulácia prostredníctvom deepfake technológií nemusí zasiahnuť len širokú verejnosť, ale dokáže cielene zneužiť dôveru jednotlivca, je prípad finančného pracovníka, ktorý prišiel o približne 25 miliónov dolárov. Stalo sa tak v januári 2024 zamestnancovi jednej hongkonskej pobočky nadnárodnej spoločnosti. (Chen & Magramo, 2024)

Podvod začal nevinne – pracovník dostal pozvánku na videohovor, v ktorej mu bolo oznámené, že bude musieť uskutočniť tajnú finančnú transakciu. Hoci bol najprv obozretný a zvažoval, či nejde o phishingový e-mail, jeho pochybnosti sa rýchlo rozplynuli keď sa videohovoru zúčastnili osoby, ktoré vyzerali a zneli presne ako jeho kolegovia. Po skončení hovoru tak podľa inštrukcií previedol celkovo 25 miliónov dolárov na cudzie účty. (Chen & Magramo, 2024)

Prípad aktuálne vyšetruje hongkonská polícia a upozorňuje, že to nie je prvý výskyt tohoto typu podvodu. Meno poškodenej spoločnosti neuviedla. (Chen & Magramo, 2024)

Možné riešenia problematiky fake news

Na riešenie problémov spojených s fake news či presnejšie deepfake je potrebné pristúpiť komplexne a z rôznych perspektív. V nasledujúcich podkapitolách sú uvedené tri možné návrhy riešení, ktoré by aspoň čiastočne mohli prispieť k obmedzeniu šírenia dezinformácií a zvýšeniu povedomia verejnosti o ich rizikách. Tieto riešenia zahŕňajú využitie technologických nástrojov na detekciu a blokovanie manipulovaného obsahu, zavedenie legislatívnych opatrení na reguláciu tvorby a šírenia nepravdivých informácií a v neposlednom rade vzdelávanie spolu s osvetovými kampaňami, ktoré posilňujú mediálnu gramotnosť a individuálnu zodpovednosť. Spoločne by tieto prístupy mohli vytvoriť solídny základ pre efektívne riešenie tohto naliehavého problému.

Technologické zabezpečenie

Prvým krokom je využiť technologické zabezpečenia, ktoré sa sústreďujú na detekciu a blokovanie nepravdivého obsahu ešte pred tým, ako sa dostane k širšiemu publiku.

Príkladom jedného z takýchto nástrojov na detekciu deepfake obsahu je produkt s názvom SynthID od spoločnosti Google. Aktuálne je dostupný v beta verzii a postupne prichádza k jeho integrácii do statných produktov od spoločnosti Google. Funguje na princípe vkladania neviditeľného digitálneho vodoznaku priamo do pixelov obrázka generovaného AI. To v ňom zanechá stopu vďaka ktorej sa dá neskôr určiť, či bola pri jeho tvorbe použitá AI. Vodoznak je samozrejme nedetekovateľný ľudským okom a nemá žiadny vplyv na vizuálnu kvalitu alebo vlastnosti obrázka. Jednou z jeho najväčších výhod je odolnosť voči úpravám obsahu. Vodoznak zostáva zachovaný aj po orezávaní, zmene veľkosti, kopírovaní alebo vytvorení snímky obrazovky, čím sa zabezpečuje, že obrázok môže byť kedykoľvek identifikovaný ako výsledok AI procesu. (Gowal & Kohli, 2023)

Legislatívne opatrenia

Jedným zo základných nástrojov zaručujúcich fungujúcu a prosperujúcu spoločnosť sú dobre nastavené legislatívne opatrenia. To sa týka aj využívania umelej inteligencia, najmä v nadväznosti na jej rapídny nárast využitia v spoločnosti.

Zatiaľ čo niektoré krajiny ešte nemajú komplexný právny rámec na reguláciu AI a deepfake technológií, iné sa už usilujú o vytvorenie opatrení, ktoré by tieto technológie regulovali. V nasledujúcich podkapitolách sa pozriem na legislatívne opatrenia prijaté v Európskej únii a Spojených štátoch amerických, keďže práve oni sú príkladom rozvinutých demokratických ekonomík.

Európska únia

Na rýchly vzostup využitia umelej inteligencie reagovala práve Európska únia. Vydala pomerne obsiahly balíček opatrení, ktorých hlavných cieľom je zabezpečiť dôveryhodné využitie umelej inteligencie s dôrazom na ochranu ľudských práv, bezpečnosť a etické konanie. Významnou súčasťou spomínaného balíčka je Akt o umelej inteligencii, [nariadenie (EÚ) 2024/1689, ktorým sa stanovujú harmonizované pravidlá v oblasti umelej inteligencie], ktorý poskytuje vývojárom a nasadzujúcim subjektom umelej inteligencie jasné požiadavky a povinnosti týkajúce sa konkrétnych použití umelej inteligencie (European Commission, 2024). To v krátkosti znamená, že osoba, ktorá vytvorí alebo šíri deepfake je povinná zmieniť sa o jeho umelom pôvode a využitých technikách. Spotrebitelia si tak budú vedomí akého pôvodu je obsah, s ktorým sa stretávajú, s čím súvisí snaha znížiť riziko, že sa stanu obeťami manipulácie.

Akt o umelej inteligencii je vôbec prvým komplexným právnym rámcom pre umelú inteligenciu na celom svete (European Commission, 2024).

Systémy umelej inteligencie tak budú rozdelené do štyroch úrovní podľa rizika, ktoré prinášajú: minimálne, obmedzené, vysoké a neprijateľné riziko. Každá z kategórií bude presne špecifikovaná a bude mať vlastné požiadavky na to, ako s údajmi obsiahnutými v danej kategórii zaobchádzať. Dodržiavania bude kontrolovať nezávislý orgán Európskej únie. (European Commission, 2024)

Európsky úrad pre umelú inteligenciu, zriadený vo februári 2024 v rámci Európskej komisie, je zodpovedný za dohľad nad implementáciou aktu o umelej inteligencii v spolupráci s členskými štátmi. Jeho hlavnou úlohou je zabezpečiť, aby technológie umelej inteligencie rešpektovali základné hodnoty, ako sú ľudská dôstojnosť, ľudské práva a dôvera verejnosti. Úrad zároveň podporuje spoluprácu medzi rôznymi stranami v oblasti vývoja, výskumu a inovácií umelej inteligencie. Okrem toho aktívne prispieva k medzinárodným diskusiám o riadení umelej inteligencie, čím zdôrazňuje význam globálneho zosúladenia pravidiel. Cieľom je, aby sa Európa stala globálnym lídrom v oblasti eticky a udržateľne vyvíjanej umelej inteligencie. (European Commission, 2024)

Akt o umelej inteligencii nadobudol účinnosť 1. augusta 2024, pričom jeho plné uplatňovanie sa plánuje o dva roky. Určité časti legislatívy však vstúpia do platnosti skôr.

Spojené štáty americké

Na rozdiel od Európskej únie a jej Aktu o umelej inteligencii, v USA zatiaľ nemajú jednotný legislatívny rámec, ktorý by komplexne reguloval deepfake technológie. Regulácia je tak zatiaľ spravovaná rôznymi zákonmi a iniciatívami na federálnych a štátnych úrovniach.

Zákon o zodpovednosti za deepfakes (H.R. 5586), známy aj pod názvom DEEPFAKES Accountability Act, bol predstavený v septembri 2023. Jeho cieľom je zvýšiť transparentnosť a zodpovednosť pri tvorbe deepfake obsahu. Návrh zákona vyžaduje, aby tvorcovia deepfake materiálov označovali tieto výtvory pomocou digitálnych vodotlačí, čo by umožnilo jednoznačne identifikovať manipulované obsah. (U.S. Congress, 2023)

Zákon zároveň zavádza trestné sankcie za neoznámenie škodlivých deepfake materiálov. Je však dôležité poznamenať, že návrh sa aktuálne vzťahuje iba na špecifické prípady ako napr. videá obsahujúce sexuálny obsah, podnecovanie násilia či zasahovanie do volieb, a nie je tak zameraný na všeobecnú reguláciu umelej inteligencie. Zároveň ale navrhuje pomerne benevolentný prístup v prípade, že sa jedná o paródie, satiru a iné formy umeleckého vyjadrenia, čím sa snaží vyvážiť ochranu pred dezinformáciami a podporu slobody prejavu. V súčasnosti je zákon vo fáze návrhu a čaká na ďalšie legislatívne prerokovanie. (U.S. Congress, 2023)

Vzdelávanie, osvetové kampane a individuálna zodpovednosť

Je veľmi pravdepodobné, že vytváraniu falošných videí či už teraz alebo naďalej v budúcnosti pravdepodobne zabrániť nedokážeme. Pomocou účinnej legislatívy vieme falošný obsah do istej miery obmedziť prípadne vinníkov za jeho tvorbu sankciovať, avšak nikdy nezískame stopercentnú istotu, že nebude ďalej vytváraný. Preto popri technologických a právnych riešeniach tohto problému netreba zabúdať na rozvoj intelektuálnych kapacít jednotlivcov.

Schopnosť kriticky myslieť je jednou z najsilnejších zbraní proti dezinformáciám, a preto by mala byť integrálnou súčasťou vzdelávacieho procesu. Učiť sa klásť otázky, ako napríklad „Kto vytvoril tento obsah?“, „Aký cieľ má jeho šírenie?“ alebo „Existujú dôveryhodné dôkazy na podporu týchto tvrdení?“, umožňuje jednotlivcom lepšie odhaliť manipulatívny obsah a odolávať klamlivým informáciám. Platformy ako BBC Reality Check či Snopes poskytujú výborné nástroje na overovanie faktov a ukazujú dôležitosť vzdelávania verejnosti v tejto oblasti. (Mirga, 2024)

Táto potreba sa však nevzťahuje len na dospelých, ale už na deti a mladých ľudí. Zavedenie mediálnej gramotnosti do školských osnov by mohlo výrazne prispieť k vytvoreniu generácie, ktorá bude odolná voči manipuláciám. Deti by sa na hodinách mediálnej gramotnosti učili rozpoznávať prvky falošných či podozrivých správ. Okrem praktických cvičení by získali aj teoretické poznatky o tom, ako funguje šírenie dezinformácií a aké stratégie sa používajú na manipuláciu verejnosti.

Prepojenie kritického myslenia so vzdelávacími programami umožní nielen lepšie pochopenie manipulatívnych praktík, ale aj schopnosť aktívne im čeliť. Napríklad simulované cvičenia, v ktorých študenti identifikujú a analyzujú falošné správy, by mohli posilniť ich schopnosť odhaliť dezinformácie v každodennom živote.

Ďalším dôležitým prístupom je budovanie kultúry osobnej zodpovednosti. Tento koncept zdôrazňuje, že každý z nás zohráva významnú úlohu v tom, ako sa šíria informácie na sociálnych sieťach. Osobná zodpovednosť zahŕňa schopnosť kriticky posudzovať zdieľaný obsah, overovať jeho zdroj a aktívne odmietať materiál, ktorý môže byť zavádzajúci. Rovnako dôležitá je aj snaha prispievať k online diskusiám pravdivými a overenými informáciami. (Mirga, 2024)

Špeciálnu pozornosť si vyžadujú mladí ľudia, ktorí často vnímajú obrázky a videá generované umelou inteligenciou len ako prostriedok zábavy. Neraz sa sami stávajú tvorcami takéhoto obsahu bez toho, aby si uvedomili možné negatívne dôsledky pre seba aj pre spoločnosť. (Mirga, 2024)

Záver

Táto práca sa zaoberala fenoménom fake news generovaných umelou inteligenciou a jej vplyvom na spoločnosť. Cieľom bolo preskúmať, ako generatívna umelá inteligencia (GAI) umožňuje tvorbu a šírenie manipulovaného obsahu, predovšetkým vo forme deepfake materiálov, ktoré zahŕňajú falošné videá, fotografie a zvukové nahrávky. V práci som sa zamerala na konkrétne príklady zneužitia týchto technológií, ktoré mali zásadný dopad na politiku, verejnú mienku a medziľudské vzťahy.

Práca ukázala, že hoci technológie AI prinášajú možnosti v oblasti kreativity a inovácie, zároveň otvárajú priestor pre zneužívanie a šírenie nepravdivých informácií. Rozoberané príklady ako deepfake videá Moldavskej prezidentky, falošný prejav ukrajinského prezidenta či nepravdivé fotografie Donalda Trumpa jasne ilustrujú, aké závažné dôsledky môžu mať tieto manipulácie v politických a spoločenských kontextoch. Tieto incidenty nielenže poškodzujú dôveru v inštitúcie, ale aj destabilizujú spoločenský poriadok, keďže vedú k šíreniu dezinformácií a polarizácii verejnosti.

Jedným z cieľom tejto práce bolo aj zameranie sa na možné riešenia týchto problémov. Kľúčovým krokom je zavedenie technologických nástrojov na detekciu a blokovanie deepfake obsahu, ako je napríklad produkt SynthID od Google, ktorý umožňuje sledovať pôvod generovaného obsahu. Okrem toho je nevyhnutné zaviesť legislatívne opatrenia, ktoré by zabezpečili transparentnosť pri tvorbe takéhoto obsahu, hoci ich implementácia nemusí byť jednoduchá. Dobrým príkladom je Európska únia, ktorá sa snaží zjednotiť pravidlá svojich členských štátov pod Akt o umelej inteligencii. Práca tiež hovorí o dôležitosti individuálnej zodpovednosti jednotlivca skrz kritické myslenie, ktoré môže byť posilňované pomocou kvalitného vzdelávania a osvetových kampaní

V konečnom dôsledku, aj keď sme svedkami rýchleho rozvoja technológií umelej inteligencie, je dôležité, aby sme sa ako spoločnosť správali zodpovedne, pretože pri umelej inteligencie pravdepodobne platí staré známe porekadlo – je dobrý sluha, ale zlý pán.

Použitá literatúra

AI-generated images of Trump being arrested circulate on social media. (2023, 21. marca). AP News. https://apnews.com/article/trump-arrest-fake-photos-viral-2023

Burgess, S. (2022, 17. marca). Ukraine war: Deepfake video of Zelenskyy telling Ukrainians to ‚lay down arms‘ debunked. Sky News. https://news.sky.com/story/ukraine-war-deepfake-video-of-zelenskyy-telling-ukrainians-to-lay-down-arms-debunked-12567789

Cambridge Dictionary. (2024). Intelligence. Cambridge Dictionary (online verzia). https://dictionary.cambridge.org/dictionary/english/intelligence

Copeland, B. J. (2024, 22. novembra). Artificial Intelligence. Britannica. https://www.britannica.com/technology/artificial-intelligence/Reasoning

European Commission. (2024, 14. októbra). AI Act. European Commission. https://digital-strategy.ec.europa.eu/sk/policies/regulatory-framework-ai

Gelfert, A. (2018, 15. marca). Fake News: A Definition. Informal Logic, 38(1), 84 – 117. https://doi.org/10.22329/il.v38i1.5068

Gowal, S. & Kohli, P. (2023, 29. augusta). Identifying AI-generated images with SynthID. Deep Mind Google. https://deepmind.google/discover/blog/identifying-ai-generated-images-with-synthid/

Gregová, S. (2024, 27. januára). Moldavská prezidentka sa stala obeťou deepfake manipulácie. Vo falošnom videu mala ironizovať životnú úroveň občanov. Infosecurity.sk. https://infosecurity.sk/articles/moldavska-prezidentka-sa-stala-obetou-deepfake-manipulacie-vo-falosnom-videu-mala-ironizovat-zivotnu-uroven-obcanov/

Chen, H., & Magramo, K. (2024,4. februára). Finance worker pays out $25 million after video call with deepfake ‘chief financial officer’. CNN. https://www.cnn.com/2024/02/04/finance-worker-deepfake-scam

Mirga, T. (2024). Dezinformácie v ére digitálnej transformácie: Generatívna AI ako nástroj tvorby rizikového syntetického obsahu – prípadová štúdia a strategické riešenia. ProInflow, 16(1), 33–95. https://doi.org/10.5817/ProIn2024-37974

Necsutu, M. (2023, 29. decembra). Moldova Dismisses Deepfake Video Targeting President Sandu. Balkan Insight. https://balkaninsight.com/2023/12/29/moldova-dismisses-deepfake-video-targeting-president-sandu/

Novak, M. (2023, 19. marca). Obrázok Donalda Trumpa vytvorený pomocou AI [Obrázok]. V Viral images of Donald Trump getting arrested are totally fake. Forbes. https://www.forbes.com/sites/mattnovak/2023/03/19/viral-images-of-donald-trump-getting-arrested-are-totally-fake/

Novak, M. (2024, 24. januára). Pope Francis Warns Of AI Dangers, Citing Fake Image Of Him That Went Viral. Forbes. https://www.forbes.com/sites/mattnovak/2024/01/24/pope-francis-warns-of-ai-dangers-after-fake-image-of-himself-went-viral/?sh=6450b59f5aa0

Oxford English Dictionary. (2023). Deepfake. Oxford English Dictionary. https://www.oed.com/dictionary/deepfake_n?tl=true&tab=etymology

Rahmanian, E. (2023). Fake news: A classification proposal and a future research agenda. Spanish Journal of Marketing – ESIC, 27(1), 60–78. https://doi.org/10.1108/SJME-09-2021-0170r

Robins-Early, N. (2024, 26. augusta). How did Donald Trump end up posting Taylor Swift deepfakes?. The Guardian. https://www.theguardian.com/technology/article/2024/aug/24/trump-taylor-swift-deepfakes-ai

Stokel-Walker, Ch. (2023, 27. marca). We Spoke To The Guy Who Created The Viral AI Image Of The Pope That Fooled The World. BuzzFeed News. https://www.buzzfeednews.com/article/chrisstokelwalker/pope-puffy-jacket-ai-midjourney-image-creator-interview

Tesař, V. (2022, 10. marca). Dezinformace a nová výzva deepfake. Magazín M: Zprávy z MUNI. https://www.em.muni.cz/udalosti/15160-dezinformace-a-nova-vyzva-deepfake

TV-NORD Moldova. (2023, 29. decembra). Un nou deepfake cu Maia Sandu, distribuit pe rețelele de socializare [Video]. YouTube. https://www.youtube.com/watch?v=jFL-ohL7BpI

U.S. Congress. (2023, 20. septembra). H.R. 5586 – DEEPFAKES Accountability Act. Congress.gov. https://www.congress.gov/bill/118th-congress/house-bill/5586/text

Umelá inteligencia: definícia a využitie. (2023, 21. júna). Európsky parlament. https://www.europarl.europa.eu/topics/sk/article/20200827STO85804/umela-inteligencia-definicia-a-vyuzitie

Wikipedia contributors. (2024, 19. októbra). Bellingcat. Wikipédia. https://cs.wikipedia.org/wiki/Bellingcat

Zewe, A. (2023, 9. novembra). Explained: Generative AI How do powerful generative AI systems like ChatGPT work, and what makes them different from other types of artificial intelligence? MIT News. https://news.mit.edu/2023/explained-generative-ai-1109